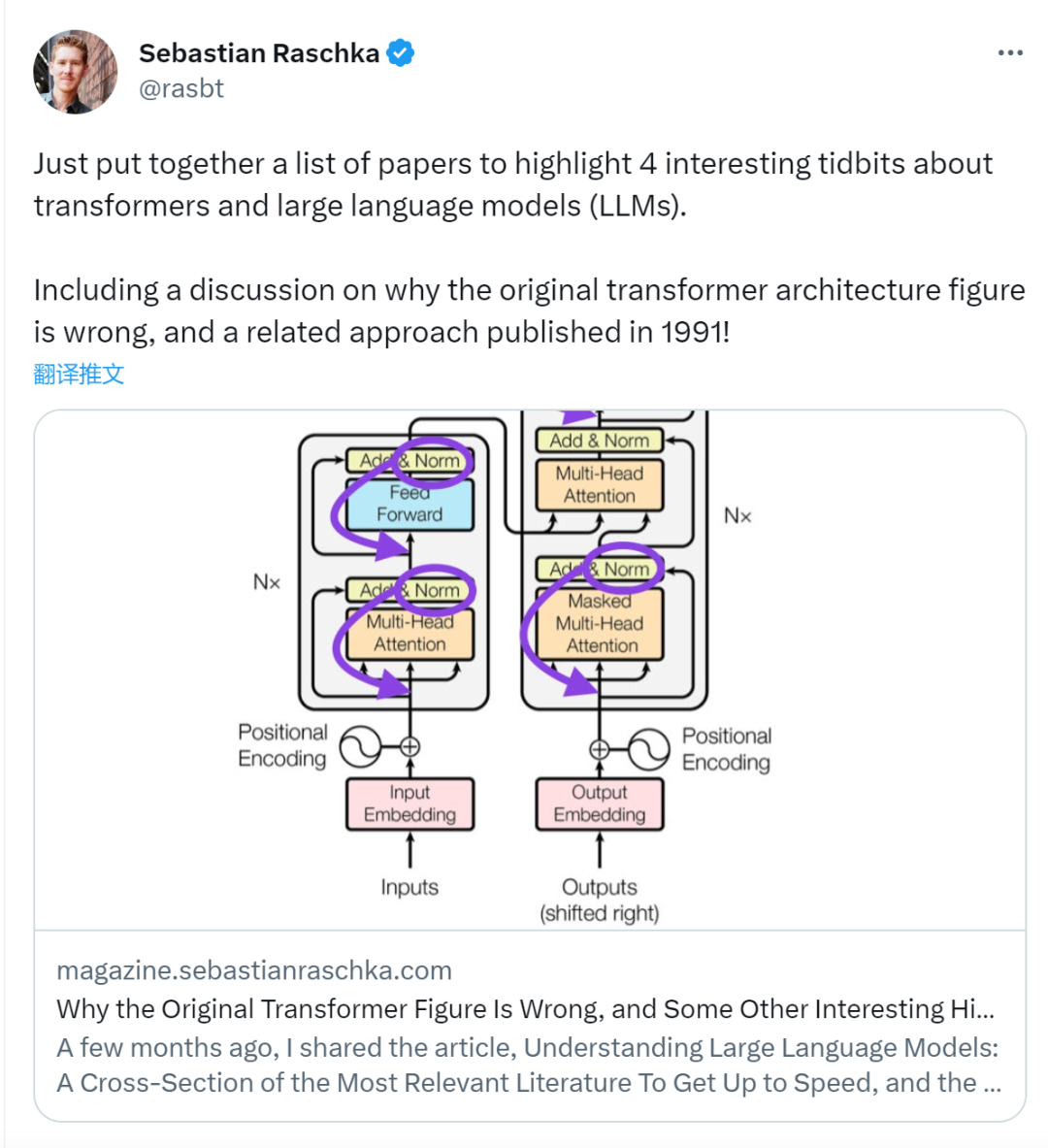

前段时间,一条指出谷歌大脑团队论文《Attention Is All You Need》中 Transformer 构架图与代码不一致的推文引发了大量的讨论。

对于 Sebastian 的这一发现,有人认为属于无心之过,但同时也会令人感到奇怪。毕竟,考虑到 Transformer 论文的流行程度,这个不一致问题早就应该被提及 1000 次。

Sebastian Raschka 在回答网友评论时说,「最最原始」的代码确实与架构图一致,但 2017 年提交的代码版本进行了修改,但同时没有更新架构图。这也是造成「不一致」讨论的根本原因。

随后,Sebastian 在 Ahead of AI 发布文章专门讲述了为什么最初的 Transformer 构架图与代码不一致,并引用了多篇论文简要说明了 Transformer 的发展变化。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

以下为文章原文,让我们一起看看文章到底讲述了什么:

几个月前,我分享了《Understanding Large Language Models: A Cross-Section of the Most Relevant Literature To Get Up to Speed》,积极的反馈非常鼓舞人心!因此,我添加了一些论文,以保持列表的新鲜感和相关性。

同时,保持列表简明扼要是至关重要的,这样大家就可以用合理的时间就跟上进度。还有一些论文,信息量很大,想来也应该包括在内。

我想分享四篇有用的论文,从历史的角度来理解 Transformer。虽然我只是直接将它们添加到理解大型语言模型的文章中,但我也在这篇文章中单独来分享它们,以便那些之前已经阅读过理解大型语言模型的人更容易找到它们。

On Layer Normalization in the Transformer Architecture (2025)

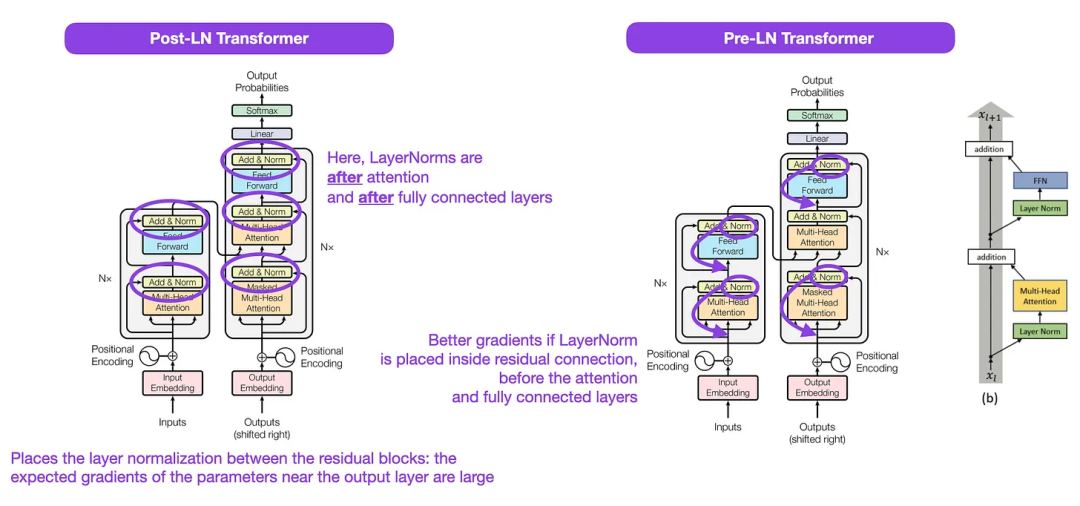

虽然下图(左)的 Transformer 原始图(https://arxiv.org/abs/1706.03762)是对原始编码器 - 解码器架构的有用总结,但该图有一个小小的差异。例如,它在残差块之间进行了层归一化,这与原始 Transformer 论文附带的官方 (更新后的) 代码实现不匹配。下图(中)所示的变体被称为 Post-LN Transformer。

Transformer 架构论文中的层归一化表明,Pre-LN 工作得更好,可以解决梯度问题,如下所示。许多体系架构在实践中采用了这种方法,但它可能导致表征的崩溃。

因此,虽然仍然有关于使用 Post-LN 或前 Pre-LN 的讨论,也有一篇新论文提出了将两个一起应用:《 ResiDual: Transformer with Dual Residual Connections》(https://arxiv.org/abs/2304.14802),但它在实践中是否有用还有待观察。

图注:图源 https://arxiv.org/abs/1706.03762 (左 & 中) and https://arxiv.org/abs/2002.04745 (右)

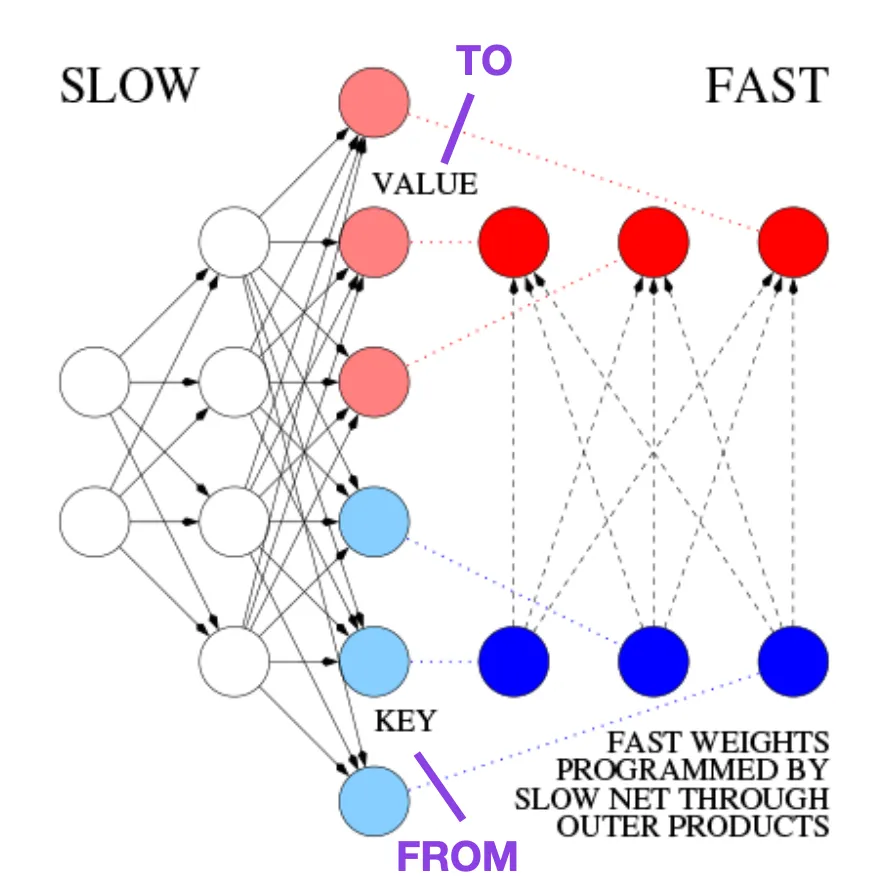

Learning to Control Fast-Weight Memories: An Alternative to Dynamic Recurrent Neural Networks (1991)

这篇文章推荐给那些对历史花絮和早期方法感兴趣的人,这些方法基本上类似于现代 Transformer。

例如,在比 Transformer 论文早 25 年的 1991 年,Juergen Schmidhuber 提出了一种递归神经网络的替代方案(https://www.semanticscholar.org/paper/Learning-to-Control-Fast-Weight-Memories%3A-An-to-Schmidhuber/bc22e87a26d020255afe91c751e5bdaddd8e4922),称为 Fast Weight Programmers (FWP)。实现快速权值变化的另一个神经网络是通过使用梯度下降算法缓慢学习的 FWP 方法中所涉及的前馈神经网络。

这篇博客 (https://people.idsia.ch//~juergen/fast-weight-programmer-1991-transformer.html#sec2) 将其与现代 Transformer 进行类比,如下所示:

在今天的 Transformer 术语中,FROM 和 TO 分别称为键 (key) 和值 (value)。应用快速网络的输入称为查询。本质上,查询由快速权重矩阵 (fast weight matrix) 处理,它是键和值的外积之和 (忽略归一化和投影)。我们可以使用加法外积或二阶张量积来实现端到端可微的主动控制权值快速变化,因为两个网络的所有操作都支持微分。在序列处理期间,梯度下降可以用于快速调整快速网络,从而应对慢速网络的问题。这在数学上等同于 (除了归一化之外) 后来被称为具有线性化自注意的 Transformer (或线性 Transformer)。

正如上文摘录所提到的,这种方法现在被称为线性 Transformer 或具有线性化自注意的 Transformer。它们来自于 2025 年出现在 arXiv 上的论文《Transformers are RNNs: Fast Autoregressive Transformers with Linear Attention 》(https://arxiv.org/abs/2006.16236)以及《Rethinking Attention with Performers》(https://arxiv.org/abs/2009.14794)。

2025 年,论文《Linear Transformers Are Secretly Fast Weight Programmers》(https://arxiv.org/abs/2102.11174)明确表明了线性化自注意力和 20 世纪 90 年代的快速权重编程器之间的等价性。

图源:https://people.idsia.ch//~juergen/fast-weight-programmer-1991-transformer.html#sec2

Seede AI

Seede AI

AI 驱动的设计工具

713

713

查看详情

查看详情

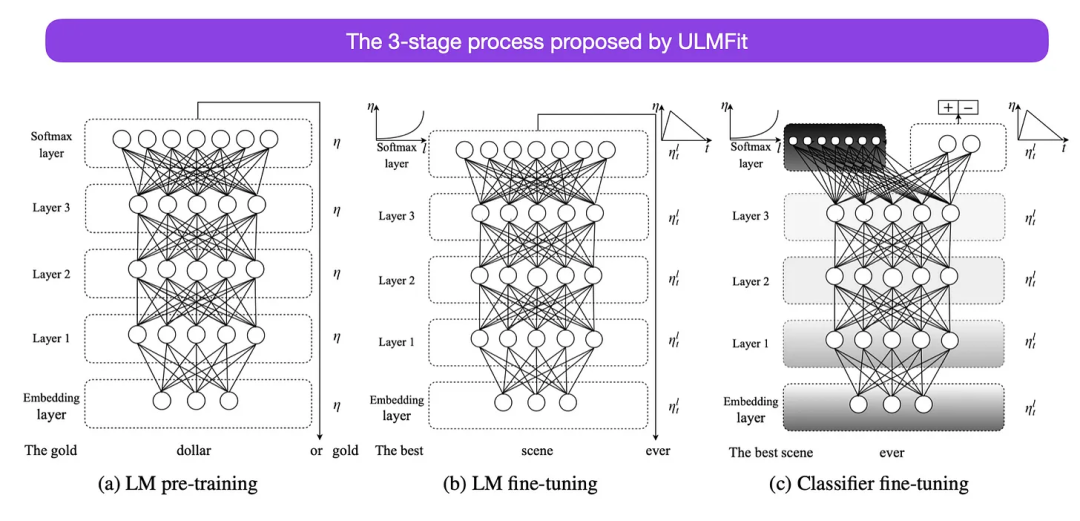

Universal Language Model Fine-tuning for Text Classification (2018)

这是另一篇从历史角度来看非常有趣的论文。它是在原版《Attention Is All You Need》发布一年后写的,并没有涉及 transformer,而是专注于循环神经网络,但它仍然值得关注。因为它有效地提出了预训练语言模型和迁移学习的下游任务。虽然迁移学习已经在计算机视觉中确立,但在自然语言处理 (NLP) 领域还没有普及。ULMFit(https://arxiv.org/abs/1801.06146)是首批表明预训练语言模型在特定任务上对其进行微调后,可以在许多 NLP 任务中产生 SOTA 结果的论文之一。

ULMFit 建议的语言模型微调过程分为三个阶段:

在大型语料库上训练语言模型,然后在下游任务上对其进行微调的这种方法,是基于 Transformer 的模型和基础模型 (如 BERT、GPT-2/3/4、RoBERTa 等) 使用的核心方法。

然而,作为 ULMFiT 的关键部分,逐步解冻通常在实践中不进行,因为 Transformer 架构通常一次性对所有层进行微调。

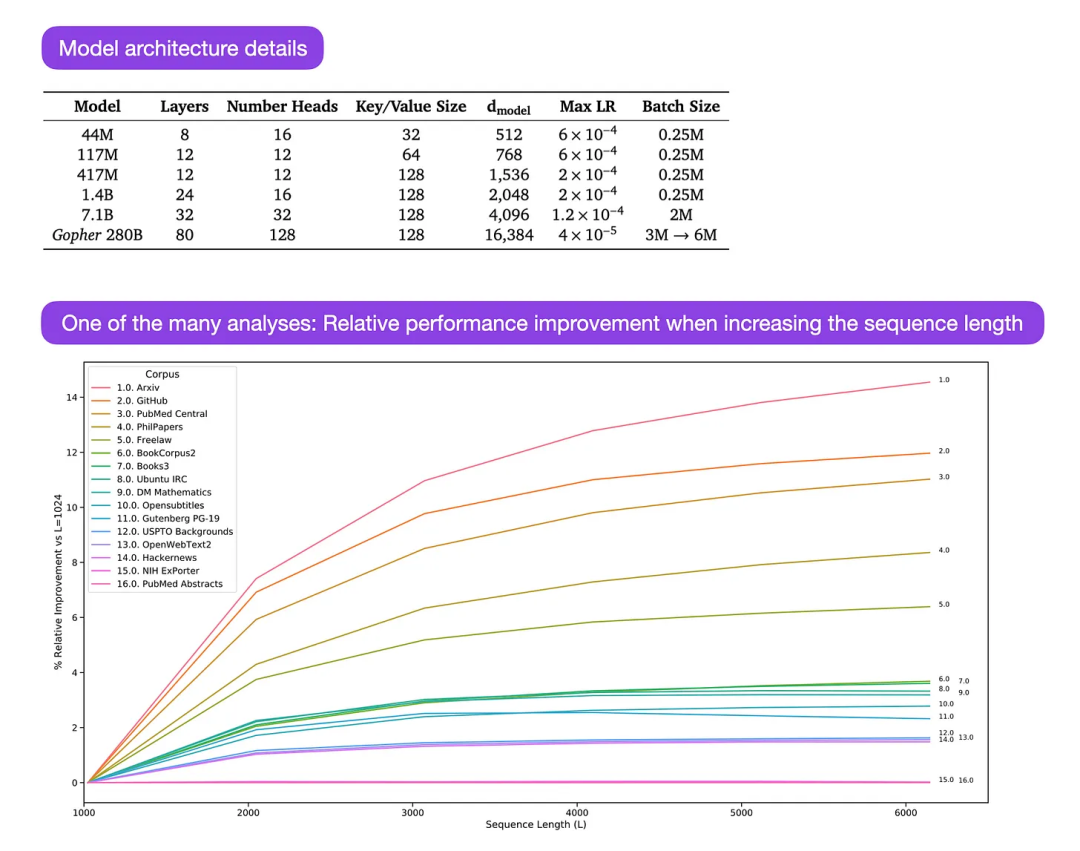

Gopher 是一篇特别好的论文(https://arxiv.org/abs/2112.11446),包括大量的分析来理解 LLM 训练。研究人员在 3000 亿个 token 上训练了一个 80 层的 2800 亿参数模型。其中包括一些有趣的架构修改,比如使用 RMSNorm (均方根归一化) 而不是 LayerNorm (层归一化)。LayerNorm 和 RMSNorm 都优于 BatchNorm,因为它们不局限于批处理大小,也不需要同步,这在批大小较小的分布式设置中是一个优势。RMSNorm 通常被认为在更深的体系架构中会稳定训练。

除了上面这些有趣的花絮之外,本文的主要重点是分析不同规模下的任务性能分析。对 152 个不同任务的评估显示,增加模型大小对理解、事实核查和识别有毒语言等任务最有利,而架构扩展对与逻辑和数学推理相关的任务从益处不大。

图注:图源 https://arxiv.org/abs/2112.11446

以上就是此「错」并非真的错:从四篇经典论文入手,理解Transformer架构图「错」在何处的详细内容,更多请关注其它相关文章!

# 但它

# 大连seo教程如何赚钱

# 五金建材推广网站

# 泰安网站建设及优化

# 优化网站排名口碑

# 白山网页seo

# 平利县关键词排名推广

# 关键词排名优化技巧价格

# 宜宾网站建设略奥网络

# 文档模板网站建设公司

# 抚顺seo优化平台

# AI

# 所示

# 被称为

# 的人

# 提出了

# 在何处

# 线性化

# 架构图

# 开源

# 递归

# 架构

相关栏目:

【

Google疑问12 】

【

Facebook疑问10 】

【

优化推广96088 】

【

技术知识133117 】

【

IDC资讯59369 】

【

网络运营7196 】

【

IT资讯61894 】

相关推荐:

统信深度deepin成立 AI SIG 社区,共同提升 Linux 下 AI 体验

真全息产品,亮相深圳文博会——dipal数伴拓展元宇宙非沉浸式体验

昇思开源社区理事会成立,基于昇思AI框架的全模态大模型“紫东.太初2.0”发布

你大脑中的画面,现在可以高清还原了

热点资讯:家乐福推出聊天机器人;米哈游2025年营收273.4亿元…

外科医生的智能助手,“机器人手术”得到补充商业医保覆盖

12页线性代数笔记登GitHub热榜,还获得了Gilbert Strang大神亲笔题词

DreamAvatar数字人在哪里下载

争鸣:OpenAI奥特曼、Hinton、杨立昆的AI观点到底有何不同?

抖音在Android平台获得VR|直播|软件著作权

AI生成新闻网站数量激增,正在疯狂赚取广告收入

人脸识别+全景双摄+AI算法 萤石推动智能锁行业革新

人工智能领域,突破难题:国产大模型“无源之水”问题得到解决。

让AI助手带您轻松愉快地享受写作之旅

北京市元宇宙产业创新中心筹建工作正式启动

Intel酷睿Ultra发布会官宣!迈向全新的AI时代

GPT-4不能在麻省理工学院获得计算机科学学位

上海发布“元宇宙关键技术攻关行动方案”,加快 AIGC 等突破

智能机器人与话剧的完美结合:宇树四足机器人B1助力《骆驼祥子》重现经典

OpenAI 向所有付费 API 用户开放 GPT-4

定义人工智能的十个关键术语

映宇宙集团执行总编辑:元宇宙还是要以人为媒介

云深处科技绝影 Lite3 与 X20 四足机器人亮相

IBM 与 NASA 携手开源地理空间 AI 模型,促进气候科学研究进步

第四范式「式说」大模型入选《2025年通用人工智能创新应用案例集》

MIT开发“PhotoGuard”技术保护图像免遭恶意AI编辑

探索人工智能和物联网的动态融合

中国联通推出“极光一号”5G机载终端,适配大疆等品牌无人机设备

大模型训练成本降低近一半!新加坡国立大学最新优化器已投入使用

AIGC 风潮刮到游戏产业,巨人网络与阿里云达成“游戏 +AI ”合作

世界人工智能大会(WAIC 2025)点燃魔都,博尔捷数字科技携前沿技术产品亮相

人工智能如何帮助制造业?

浪潮KaiwuDB:“快人一步” - 打造更懂物联网的数据库

微幼科技晨检机器人:幼儿园健康保障的新伙伴

干货满满,2025昆山元宇宙国际装备展等你来打卡!

科技赋能司法执行 阿里资产免费为全国法院升级VR新服务

这效果能打几分?AI真人化《名侦探柯南》

V社悄悄封禁使用AI生成美术素材的游戏

一文看懂基础模型的定义和工作原理

麦肯锡:到 2045 年左右,将有 50% 工作被 AI 接管

央视报道!星纪魅族集团车载人机交互技术成世界移动通信大会焦点

美图设计室2.0新增哪些功能

精准度可提高 20%:英国九家银行签约使用基于 AI 的“消费者欺诈风险系统”应对*

百度创始人、董事长兼首席执行官李彦宏:AI原生应用比大模型数量更重要

英国前首相:AI可能被用来制造“生物恐怖武器”

华为大模型登Nature正刊!审稿人:让人们重新审视预报模型的未来

AI 助手 Copilot 上线,微软 Win11 Dev 预览版 Build 23493 发布

苹果AIGC专利:可通过语音指令生成AR/VR虚拟场景

PS AI修图免费平替来了!Stability AI又放大招,核弹级更新一键扩图

13条咒语挖掘GPT-4最大潜力,Github万星AI导师火了,网友:隔行再也不隔山了

2023-06-14

运城市盐湖区信雨科技有限公司是一家深耕海外推广领域十年的专业服务商,作为谷歌推广与Facebook广告全球合作伙伴,聚焦外贸企业出海痛点,以数字化营销为核心,提供一站式海外营销解决方案。公司凭借十年行业沉淀与平台官方资源加持,打破传统外贸获客壁垒,助力企业高效开拓全球市场,成为中小企业出海的可靠合作伙伴。